Bienvenue sur IA Pulse Weekend. Cette édition porte le numéro 75. En vous abonnant, vous recevez tous les samedis matin, l’essentiel de ce qu’il s’est passé cette semaine autour de l’IA : un coup de gueule édito, une sélection de 3 actualités avec pour chacune un résumé rapide à lire, plus 1 article de fond pour ouvrir l’esprit et réfléchir et 1 podcast à écouter.

⏱️Temps de lecture de cette newsletter par une unité carbone : 10 mins

Cette semaine sous nos yeux ébahis, les fabricants de l’intelligence ont sorti l’artillerie lourde. OpenAI, Google et Apple pour ne citer qu’eux, nous ont à la fois éblouis, bluffés, questionnés, agacés et par moments déçus.

Dans cette édition, nous allons parler ensemble d’o1, le modèle qui raisonne a.k.a. la fraise d’OpenAI. Pour cela, je l’utilise ce matin pour générer les textes des clusters d’actus et pour le ping-pong de “l’article qui fait réfléchir”. Ai-je gagné du temps ? Pas vraiment. Comme tout modèle il doit être apprivoisé - ce qui est peu compliqué avec une limite de 30 interactions par semaine imposée par OpenAI. Ai-je été bluffé par les résultats ? En gros oui. Mais surtout bluffé par l’interface utilisateur : quelle “bonne” idée de laisser à l’utilisateur le loisir de lire toute la chaine d’instructions et de raisonnements. Le CoT en direct, sans y participer.

Mais le raisonnement n’est pas le seul des défis auxquels doivent faire face nos LLM préférés. La “factualité” des informations délivrées est tout aussi importante. Pour cela Google a dévoilé DataGemma, un ensemble de modèles et de techniques qui doivent permettre aux LLM de moins halluciner et d’être plus ancrés dans la réalité.

Et pour pouvoir mettre en œuvre et utiliser cette “faculté raisonnement” et cette “recherche de factualité”, quoi de mieux qu’un appareil de type smartphone que nous avons tous dans nos poches. Apple dans sa présentation de son nouvel iPhone et de son “Apple Intelligence” nous montre le début de ce chemin : l’intelligence fabriquée au creux de ta main.

Si vous voulez plus d’informations et des tests plus poussés sur o1 que je n’ai pas la place de faire ici, je vous invite à lire l’édition de demain de la newsletter de Benoît Raphael et de son comparse Thomas Mahier.

Si vous n’êtes pas abonné, c’est par ici : https://generationia.flint.media/subscribe

Cette semaine la partie de cette newsletter gérée par l’IA, les 3 clusters d’articles, a été générée par o1-preview pour les résumés des articles sources, la génération du cluster et de son titre. Comme d’habitude j’ai fait quelques modifications, mais j’ai aussi laissé quelques tournures typiques des modèles de langage. Et bien entendu, mes commentaires éventuels sont en italique dans ces résumés. Le texte de “l’article qui fait réfléchir” est issu d’un ping-pong entre o1-preview et Claude-3.5-Sonnet.

L’image d’illustration ci-dessous est générée par Midjourney.

📰 Les 3 infos de la semaine

🍓OpenAI lance son nouveau modèle linguistique o1, axé sur le raisonnement

OpenAI a dévoilé jeudi son dernier modèle de langage, o1, qui nous promet des améliorations en matière de raisonnement et de résolution de problèmes complexes. Disponible en deux versions, o1-preview et o1-mini, ce modèle est conçu pour exceller dans les domaines scientifiques, technologiques, de l'ingénierie et des mathématiques.

Selon OpenAI, o1-preview surpasse GPT-4o dans plusieurs benchmarks, notamment en programmation compétitive, en mathématiques et en "raisonnement scientifique". Il s'est classé dans le 89e percentile sur les questions de programmation de Codeforces et a obtenu 83 % à un examen qualificatif pour l'Olympiade Internationale de Mathématiques, contre 13 % pour GPT-4o.

o1-mini est une version plus légère et rapide, optimisée pour le codage et proposée à un coût inférieur de 80 % par rapport à o1-preview, offrant une option économique pour les développeurs.

La réelle avancée de o1 repose sur une nouvelle approche d'apprentissage par renforcement et de "raisonnement multi-étapes" - le CoT appliqué de manière automatique et systématique, permettant au modèle de "réfléchir" de manière itérative avant de répondre. Cette méthode lui permet d'explorer différentes stratégies et de reconnaître ses erreurs, améliorant sa capacité à résoudre des problèmes complexes.

Cependant, certains utilisateurs notent que o1 ne surpasse pas systématiquement GPT-4o dans tous les domaines - et de loin, et que son temps de réponse est plus lent en raison de son processus de réflexion approfondi. OpenAI reconnaît ces limitations et indique que GPT-4o reste le meilleur choix pour la plupart des demandes, en particulier pour les tâches simples.

Malgré ça, o1 montre un potentiel prometteur dans la planification, la résolution de problèmes complexes et la génération de documents détaillés. Il peut, par exemple, élaborer des plans d'action complets, optimiser des emplois du temps ou créer des applications et des jeux, ce qui pourrait être particulièrement utile pour les professionnels nécessitant une analyse approfondie.

OpenAI prévoit d'améliorer o1 en ajoutant des fonctionnalités telles que la navigation web, la génération d'images et le téléchargement de fichiers - oui pour le moment le modèle n’est pas multimodal, il n’accepte aucun apport de fichier et il est bridé à 30 interactions par semaine pour o1-preview et 50 par semaine pour o1-mini. Pas simple pour tester.

Pourquoi est-ce important ? o1 représente semble représenter une avancée dans le raisonnement automatique et dans la capacité des modèles d'IA à gérer des tâches complexes de raisonnement, ce qui pourrait transformer notre approche de la résolution de problèmes dans divers secteurs.

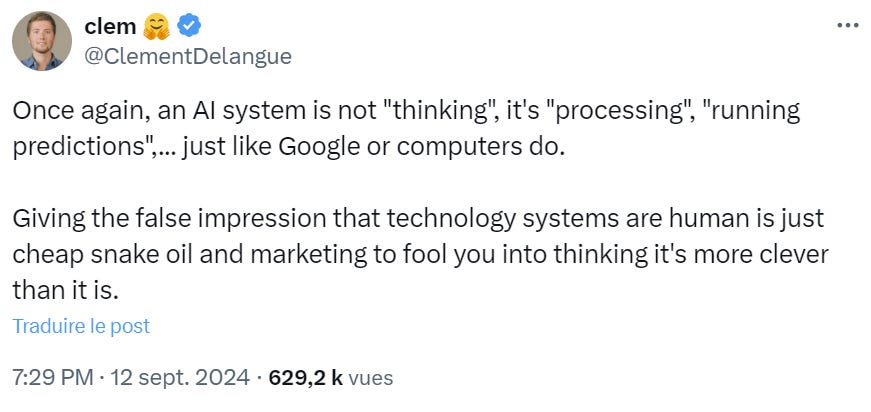

Je laisse le mot de la fin à Clément Delangue, CEO d’Hugging Face :

Sources : Ars Technica, TechCrunch, VentureBeat, Tibor Blaho, Clement Delangue

🦸 Ancrer les modèles de langage dans la réalité : l'approche DataGemma de Google

Les LLM ont transformé notre manière d'interagir avec l'information. Cependant, ils présentent une difficulté majeure : ils peuvent générer des informations inexactes, un phénomène connu sous le nom d'« hallucination » ou de « confabulation ». Ce problème est particulièrement prononcé lorsqu'il s'agit de données statistiques ou factuelles.

Pour y répondre, Google vient d’annoncer DataGemma, une série de modèles ouverts conçus pour ancrer les LLM dans des données réelles et fiables. DataGemma utilise le Data Commons de Google, un vaste graphe de connaissances publiques contenant plus de 240 milliards de points de données provenant de diverses sources.

DataGemma améliore la précision des LLM en utilisant deux approches distinctes et complémentaires. La première, appelée RIG (Retrieval-Interleaved Generation), agit comme un vérificateur de faits en comparant les réponses initiales du modèle avec les données de Data Commons. La seconde, nommée RAG (Retrieval-Augmented Generation), récupère les informations pertinentes avant de générer une réponse, fournissant ainsi au modèle une base factuelle plus solide.

Les premiers résultats sont assez prometteurs. Avec la méthode RIG, le taux de précision des réponses est passé de 5-17% à environ 58%. Le RAG a également montré des améliorations, bien que moindres. Au final, ces deux approches tentent de contribuer à réduire les hallucinations en ancrant les réponses des LLM dans des données vérifiables.

Néanmoins, de gros défis subsistent. En premier, l'efficacité de ces méthodes dépend de la disponibilité des données pertinentes dans le Data Commons. En second, le modèle doit être capable de formuler correctement les requêtes pour accéder aux informations nécessaires - et ça ce n’est pas toujours simple . La méthode RIG n'a pu obtenir des données utilisables que dans 25% des cas testés, tandis que la méthode RAG a parfois eu du mal à tirer des conclusions correctes à partir des chiffres (6 à 20% d'erreurs d'interprétation).

Pourquoi est-ce important ? Renforcer la fiabilité des modèles de langage permet de fournir des informations plus précises aux utilisateurs, favorisant alors une prise de décision éclairée et une meilleure compréhension du monde. Ce qui est essentiel pour leur utilisation dans des domaines tels que la recherche, la prise de décision et l'information du public.

Sources : Google Research, VentureBeat, MIT Technology Review

🎰 Apple mise sur l'intelligence artificielle Apple Intelligence

En début de semaine Apple a dévoilé l'iPhone 16, en mettant en avant de nouvelles fonctionnalités basées sur l'intelligence artificielle regroupées sous le nom "Apple Intelligence".

Parmi les nouvelles fonctionnalités, Siri va bénéficier d'une meilleure compréhension du langage naturel, pouvant interpréter des commandes complexes même en cas d'hésitation dans la voix. L'assistant vocal pourra accéder à des informations personnelles, comme retrouver une recommandation de série télévisée mentionnée précédemment.

L’IA s'invite également dans la gestion des messages et des emails. Apple Intelligence pourra résumer les conversations, prioriser les emails importants et reformuler des textes pour adapter leur ton, par exemple lors de la rédaction d'un message professionnel. Un outil de relecture permettra de modifier le style d'un message avant son envoi.

Côté photo, la fonctionnalité "visual intelligence" permet d'identifier le contenu d'une image, comme la race d'un chien photographié, ou de créer des diaporamas personnalisés à partir des photos de l'utilisateur.

La plupart de ces fonctionnalités ne seront disponibles qu'à partir du mois prochain, et certaines ne seront déployées qu'en 2025 - en particulier dans nos contrées certainement trop éloignées… De plus, leur utilisation sera limitée aux iPhone 15 Pro et aux nouveaux iPhone 16, ce qui pourrait restreindre leur adoption à court terme.

Pourquoi est-ce important ? L'intégration de l'intelligence artificielle dans l'iPhone 16 marque une étape - les tics de langage sont toujours là, o1 ou pas - dans la stratégie d'Apple pour se positionner sur ce marché en évolution, influençant potentiellement la direction future des smartphones et notre interaction quotidienne avec la technologie.

Sources : The Wall Street Journal, TechCrunch, Wired

🚀 3 infos en plus

Will California flip the AI industry on its head? (The Verge)

This AI chatbot got conspiracy theorists to question their convictions (Nature)

OpenAI’s Fund-Raising Talks Could Value Company at $150 Billion (The New York Times)

🔴 A lire sur IA-Pulse Hors Série

Particle News : l'info et l'IA : l'appli de deux anciens de Twitter dont les fonctionnalités IA devraient inspirer la presse et les médias.

🧠 L’article qui fait réfléchir - et qu’il faut absolument lire

Don’t ask if AI can make art — ask how AI can be art

La créativité c'est un raisonnement

L'intelligence artificielle générative soulève des questions sur sa capacité à créer de l'art. Les outils comme ChatGPT, DALL-E ou Midjourney, bien que techniquement sophistiqués, produisent souvent du contenu générique. Cette tendance inquiète les artistes, qui craignent une dévaluation de leur travail et des pertes financières.

Mais paradoxalement - et tous ceux qui utilisent fréquemment ces outils le savent, l'attrait de ces technologies réside moins dans leurs résultats que dans l'interaction qu'elles offrent. Les utilisateurs apprécient le processus de création et de partage, et explorent les limites des systèmes d'IA pour obtenir des résultats inattendus ou humoristiques. Cette expérience s'apparente à la résolution d'un puzzle ou à la construction dans un jeu vidéo, suggérant le potentiel de l'IA comme base d'un nouveau genre de média interactif.

L'art algorithmique a une riche histoire, des expériences de l'Oulipo aux jeux vidéo à génération procédurale. Des projets récents comme "Hey Robot" ou "AI Dungeon" illustrent comment l'IA peut être intégrée de manière interactive, permettant aux utilisateurs de co-créer des expériences uniques. Ces projets, qui nécessitent une participation active de l’utilisateur, évitent le caractère impersonnel souvent associé au contenu généré par l'IA. Ils offrent des expériences difficilement reproductibles par des méthodes traditionnelles et explorent les vastes possibilités offertes par les modèles d'IA entraînés sur de grandes quantités de données.

Cependant, les grandes entreprises d'IA semblent privilégier les applications commerciales et productives, imposant des restrictions qui limitent l'expérimentation artistique. Cette approche, combinée à des préoccupations éthiques et juridiques, freine l'innovation dans l'art interactif basé sur l'IA. Les outils open source offrent une alternative, mais manquent souvent de visibilité et d'accessibilité.

Il ne faut pas oublier aussi que la tension est réelle entre l'industrie de l'IA et les artistes. Certains promoteurs de l'IA minimisent les préoccupations des créateurs et prônent une utilisation sans restriction de leurs œuvres comme données d'entraînement, entravant ainsi la collaboration et dissuadant les artistes d'adopter l'IA comme outil d'innovation.

Bien que l'IA produise souvent du contenu peu inspiré, son véritable potentiel artistique réside dans l'interaction et l'expérience qu'elle peut offrir. Comment pourrions-nous favoriser une synergie entre artistes et développeurs d'IA pour exploiter ce potentiel créatif, en préservant et en valorisant la créativité humaine, tout en offrant une expérience utilisateur unique ? Demandez à o1 ^^

📻 Le podcast de la semaine

Comptoir IA : "Le coût de l'intelligence va tendre vers ZÉRO"

Pierre Valade, CEO de WorkflowAI, partage sa vision optimiste sur l'IA générative, ses impacts, et évoque son futur pour améliorer quotidien, éducation, climat.

👨🏽🦳👩🏽🦳 C’était mieux avant - Il y a 1 an

N’hésitez à me contacter si vous avez des remarques et suggestions sur cette newsletter, ou si dans votre entreprise vous cherchez à être accompagnés dans l’intégration d’outils IA et d’IA générative : olivier@255hex.ai

Partagez cette newsletter

Et si vous n’êtes pas abonné, il ne tient qu’à vous de le faire !

Bon weekend.

Encore un numéro de bonne facture. 👍

Et joli ton titre : Apple mise sur l̶'̶i̶n̶t̶e̶l̶l̶i̶g̶e̶n̶c̶e̶ ̶a̶r̶t̶i̶f̶i̶c̶i̶e̶l̶l̶e̶ ̶ Apple Intelligence